di John Nash, da Domenica , Sole 24ore del 27 sett 09 ................Il dilemma del prigioniero ripetuto porta a un risultato paradossale: da una situazione di impasse si impara ad aver fiducia negli altri  Lo spunto per questo lavoro mi è venuto qualche tempo fa, da un incontro con studenti universitari che frequentavano un campo estivo dedicato alla scienza. Stavo parlando di evoluzione in natura e mi sembrava che, tale argomento si prestasse a essere indagato con la teoria dei giochi, di uso più frequente nelle ricerche economiche. Dopo quell'incontro ho voluto vedere se era possibile costruire modelli di cooperazione, attraverso mosse di accettazione con le quali un giocatore può semplicemente accettare [o rifiutare] l'agency di un altro, o di una preesistente coalizione di giocatori. La mossa doveva assumere una forma interamente cooperativa, come se fosse "altruistica", senza nulla di competitivo. Le partite sarebbero state ripetute più volte, ogni giocatore avrebbe potuto reagire in maniera non cooperativa se un altro esibiva una sequenza di comportamenti indesiderati. Il gioco, insomma, somigliava alle partite reiterate del Dilemma del prigioniero,

Lo spunto per questo lavoro mi è venuto qualche tempo fa, da un incontro con studenti universitari che frequentavano un campo estivo dedicato alla scienza. Stavo parlando di evoluzione in natura e mi sembrava che, tale argomento si prestasse a essere indagato con la teoria dei giochi, di uso più frequente nelle ricerche economiche. Dopo quell'incontro ho voluto vedere se era possibile costruire modelli di cooperazione, attraverso mosse di accettazione con le quali un giocatore può semplicemente accettare [o rifiutare] l'agency di un altro, o di una preesistente coalizione di giocatori. La mossa doveva assumere una forma interamente cooperativa, come se fosse "altruistica", senza nulla di competitivo. Le partite sarebbero state ripetute più volte, ogni giocatore avrebbe potuto reagire in maniera non cooperativa se un altro esibiva una sequenza di comportamenti indesiderati. Il gioco, insomma, somigliava alle partite reiterate del Dilemma del prigioniero,  utilizzato ora anche dalla biologia teorica. In quésta disciplina ha già rivelato una possibilità paradossale: ilcomportamento cooperativo può risultare da un' evoluzione naturale pur partendo dal presuppostoi che gli organismi o le specie, in interazione siano spinti dal proprio interesse, cioè da un motivo non cooperativo.

Personalmente.penso che gli esperimenti siano la strada giustaper scoprire «la verità ultima» su come giocano gli esseri umani. A mettere in pratica la teoria dei giochi però, ci sono

anche corporazioni e stati. Un'analisi del gioco così com'è praticato ridotta a quella del comportamento umano sarebbe poco utile. Quindi non siamo ricorsi a volontari e abbiamo simulato al computer il comportamento evolutivamente stabile di una triade di giocatori che contrattavano tra dì loro. Dal punto divista sperimentale, la triade equivale a un insieme di tre, robot e la capacìtà di svolgerere esperimento diventa una mera questione di matematica. (...)'

Nella simulazione, a volte i giocatori "devono" accettare globalmente le azioni altrui, sebbene còn riluttanza, o non otterrebbero mai i vantaggi di una coalizione, specificati dalla funzione matematìca che li caratterizza. È abbastanza ovvìo che la mossa di accettazione è quasi altruistica, perché l'agente non è costretto a considerare gli ìnteressi di altri giocatori* "se non" attraverso la struttura contestuale del gioco reiterato e attraverso le reazioni altrui incorporate nella struttura del modello.

utilizzato ora anche dalla biologia teorica. In quésta disciplina ha già rivelato una possibilità paradossale: ilcomportamento cooperativo può risultare da un' evoluzione naturale pur partendo dal presuppostoi che gli organismi o le specie, in interazione siano spinti dal proprio interesse, cioè da un motivo non cooperativo.

Personalmente.penso che gli esperimenti siano la strada giustaper scoprire «la verità ultima» su come giocano gli esseri umani. A mettere in pratica la teoria dei giochi però, ci sono

anche corporazioni e stati. Un'analisi del gioco così com'è praticato ridotta a quella del comportamento umano sarebbe poco utile. Quindi non siamo ricorsi a volontari e abbiamo simulato al computer il comportamento evolutivamente stabile di una triade di giocatori che contrattavano tra dì loro. Dal punto divista sperimentale, la triade equivale a un insieme di tre, robot e la capacìtà di svolgerere esperimento diventa una mera questione di matematica. (...)'

Nella simulazione, a volte i giocatori "devono" accettare globalmente le azioni altrui, sebbene còn riluttanza, o non otterrebbero mai i vantaggi di una coalizione, specificati dalla funzione matematìca che li caratterizza. È abbastanza ovvìo che la mossa di accettazione è quasi altruistica, perché l'agente non è costretto a considerare gli ìnteressi di altri giocatori* "se non" attraverso la struttura contestuale del gioco reiterato e attraverso le reazioni altrui incorporate nella struttura del modello. A volte, il giocatore che accetta "esigerà" di essere premiato con il livello di benefici da lui scelto, commisurato alle conseguenze utilitarie medie di un suo voto di accettazione. ............ Vale a dire che i giocatori potevano trasformarsi in negoziatori avveduti, in paziente attesa che la controparte facesse concessioni. L'inserimento nel modellò di una «accettazione riluttante asintotticamente perfetta» ha procurato un altro vantaggio. Ha eliminato una regola apparentemente àrbitrariadélvoto, secondo la quale la partecipazione di più di un elettore rendeva certificata ed effettiva una singola mossa di voto scelta a caso. Con i miei colleghi, ho cercato per più di un anno di trovare una buona variante del modello, in cui le parti avrebbero adottato modalità cooperative con l'assistenza di agenti che avrebbero pilotato il processo per conto dei giocatori iniziali Mi sembrava normale, si osservano analoghi comportamenti cooperativi nelle società umane.

Ma Io sforzo è andato a vuoto, perlomeno nella forma in cui è stato tentato. il problema, in parte, era che la riluttanza di un giocatore ad accettare l'intermediazione di un agente, un avvocato per esempio, sembra innaturale se l'agente è adatto a svolgere bene la propria funzione. (Avevamo concepito una funzione robotica per gli agenti-avvocati Nel caso speciale di un gioco a due partecipanti, era risultato in precedenza che un esito cooperativo "era" realizzabile nel modello in cui avevano "entrambi" bisogno di accettare la funzione di uno specifico agente-avvocato robotico per riuscire a cooperare, e per accedere così ai benefici utilitari disponibili solo in condizioni di cooperazione). Ma non siamo riusciti a trovare un buon modello che comprendesse la funzione robotica di agenti-legali nei giochi con tre partecipanti. C'era la complicazione dei diversi "stadi" nella coalizione dei giocatori, e in fin dei conti sembrava diventare "troppo vantaggioso" per due dei giocatori iniziali essere rappresentati da un agente-avvocato:

A volte, il giocatore che accetta "esigerà" di essere premiato con il livello di benefici da lui scelto, commisurato alle conseguenze utilitarie medie di un suo voto di accettazione. ............ Vale a dire che i giocatori potevano trasformarsi in negoziatori avveduti, in paziente attesa che la controparte facesse concessioni. L'inserimento nel modellò di una «accettazione riluttante asintotticamente perfetta» ha procurato un altro vantaggio. Ha eliminato una regola apparentemente àrbitrariadélvoto, secondo la quale la partecipazione di più di un elettore rendeva certificata ed effettiva una singola mossa di voto scelta a caso. Con i miei colleghi, ho cercato per più di un anno di trovare una buona variante del modello, in cui le parti avrebbero adottato modalità cooperative con l'assistenza di agenti che avrebbero pilotato il processo per conto dei giocatori iniziali Mi sembrava normale, si osservano analoghi comportamenti cooperativi nelle società umane.

Ma Io sforzo è andato a vuoto, perlomeno nella forma in cui è stato tentato. il problema, in parte, era che la riluttanza di un giocatore ad accettare l'intermediazione di un agente, un avvocato per esempio, sembra innaturale se l'agente è adatto a svolgere bene la propria funzione. (Avevamo concepito una funzione robotica per gli agenti-avvocati Nel caso speciale di un gioco a due partecipanti, era risultato in precedenza che un esito cooperativo "era" realizzabile nel modello in cui avevano "entrambi" bisogno di accettare la funzione di uno specifico agente-avvocato robotico per riuscire a cooperare, e per accedere così ai benefici utilitari disponibili solo in condizioni di cooperazione). Ma non siamo riusciti a trovare un buon modello che comprendesse la funzione robotica di agenti-legali nei giochi con tre partecipanti. C'era la complicazione dei diversi "stadi" nella coalizione dei giocatori, e in fin dei conti sembrava diventare "troppo vantaggioso" per due dei giocatori iniziali essere rappresentati da un agente-avvocato: non potevano più - in un equilibrio del loro gioco - comportarsi come se fossero riluttanti ad accettarne l'agency.

Con il senno di poi, è chiaro che il nostro schema di agenti avvocati robotici , concepiti

per operare a vantaggio degli interessi dei giocatori originari, non corrispondeva alla "vita reale". Nella società umana dopotutto, è la "competizione" tra gli avvocati che li spinge a difendere i veri interessi dei loro assistiti!

per comprendere megio vedi anche il post : "come si riformano le regole"

non potevano più - in un equilibrio del loro gioco - comportarsi come se fossero riluttanti ad accettarne l'agency.

Con il senno di poi, è chiaro che il nostro schema di agenti avvocati robotici , concepiti

per operare a vantaggio degli interessi dei giocatori originari, non corrispondeva alla "vita reale". Nella società umana dopotutto, è la "competizione" tra gli avvocati che li spinge a difendere i veri interessi dei loro assistiti!

per comprendere megio vedi anche il post : "come si riformano le regole"

venerdì 2 ottobre 2009

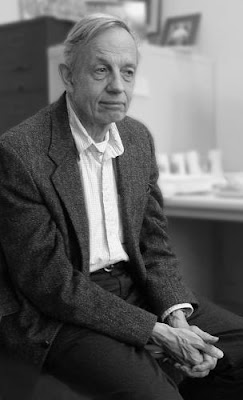

John Nash , matematico, Nobel , su giochi strategici e comportamento sociale

Iscriviti a:

Commenti sul post (Atom)

Nessun commento:

Posta un commento